Deep Learningにおける対称性の組み込みについて

カリフォルニア工科大学のYoutube動画「Deep Learningにおける対称性の組み込みについて」について要点と要約をまとめました

3つの要点

- 要点1

対称性の組み込みによるAIの説明可能性の向上 - 要点2

同変ネットワークの利用による科学的応用の進展 - 要点3

保存則と対称性の関係の探求

要約

AIの説明可能性のために対称性を組み込む重要性

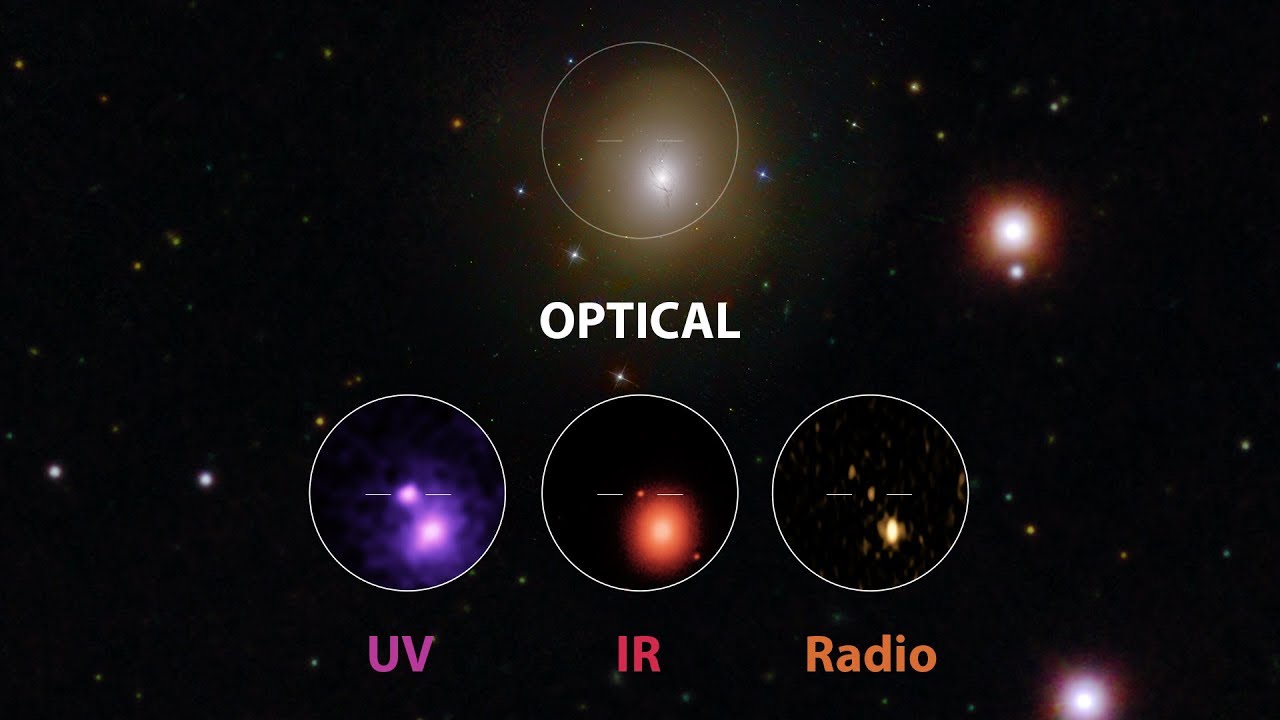

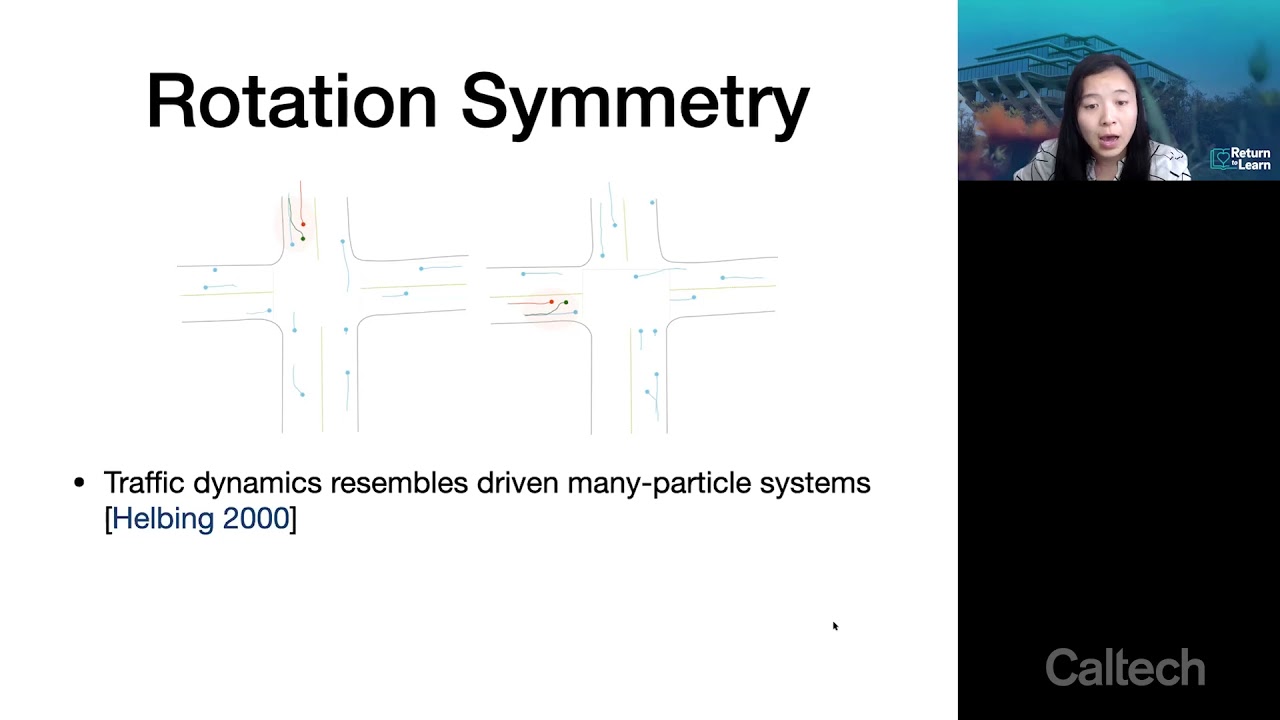

この講演では、AIの説明可能性を実現するために、深層学習モデルに対称性を組み込む重要性について議論しました。異なるユーザーグループはAIアルゴリズムに対する信頼基準が異なり、科学者にとっては保存則の満足が信頼構築において重要です。保存則と対称性の関係を探求し、対称性を深層学習モデルに統合することで、一般化能力を向上させ、サンプルの複雑さを減らし、AIへの信頼を高めることができます。

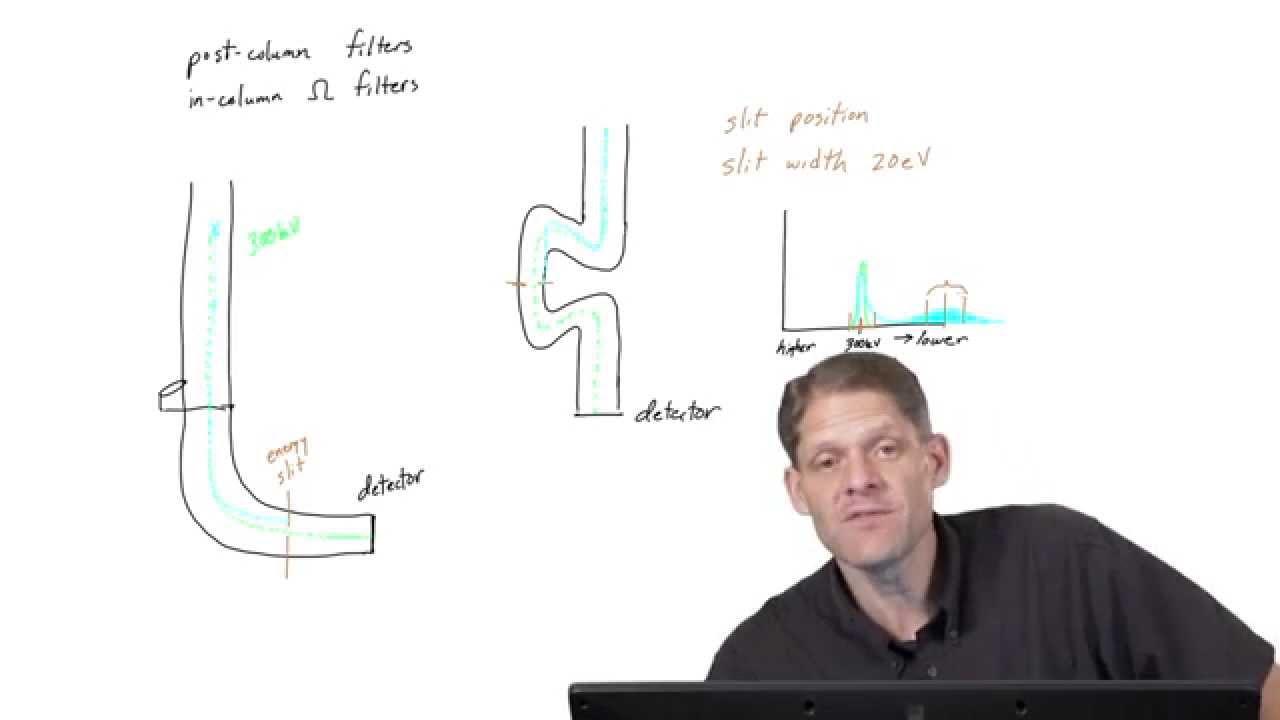

科学的応用のための同変ネットワークの構築

深層学習モデルで同変性を実現するために、群論を使用し、不変性を持つ畳み込み層を設計します。

要点1: 対称性の組み込みによるAIの説明可能性の向上

対称性を深層学習モデルに組み込むことで、AIの説明可能性が向上します。異なるユーザーグループの信頼基準に応えるためには、保存則の満足が重要です。

要点2: 同変ネットワークの利用による科学的応用の進展

同変ネットワークを使用することで、科学的応用の領域での進展が期待されます。群論を活用し、不変性を持つ畳み込み層を設計することで、より正確な結果が得られる可能性があります。

▼今回の動画

編集後記

▼ライターの学び

AIの説明可能性を向上させるためには、対称性を深層学習モデルに組み込むことが重要であると学びました。異なるユーザーグループに対しても、保存則を満たすことが信頼構築につながるということを理解しました。

▼今日からやってみよう

今日からは、AIモデルの設計において対称性を意識し、保存則を満たすようなアルゴリズムを採用してみることができます。また、同変ネットワークを使用することで、科学的な応用領域での成果を高めることができるので、それに挑戦してみることもおすすめです。