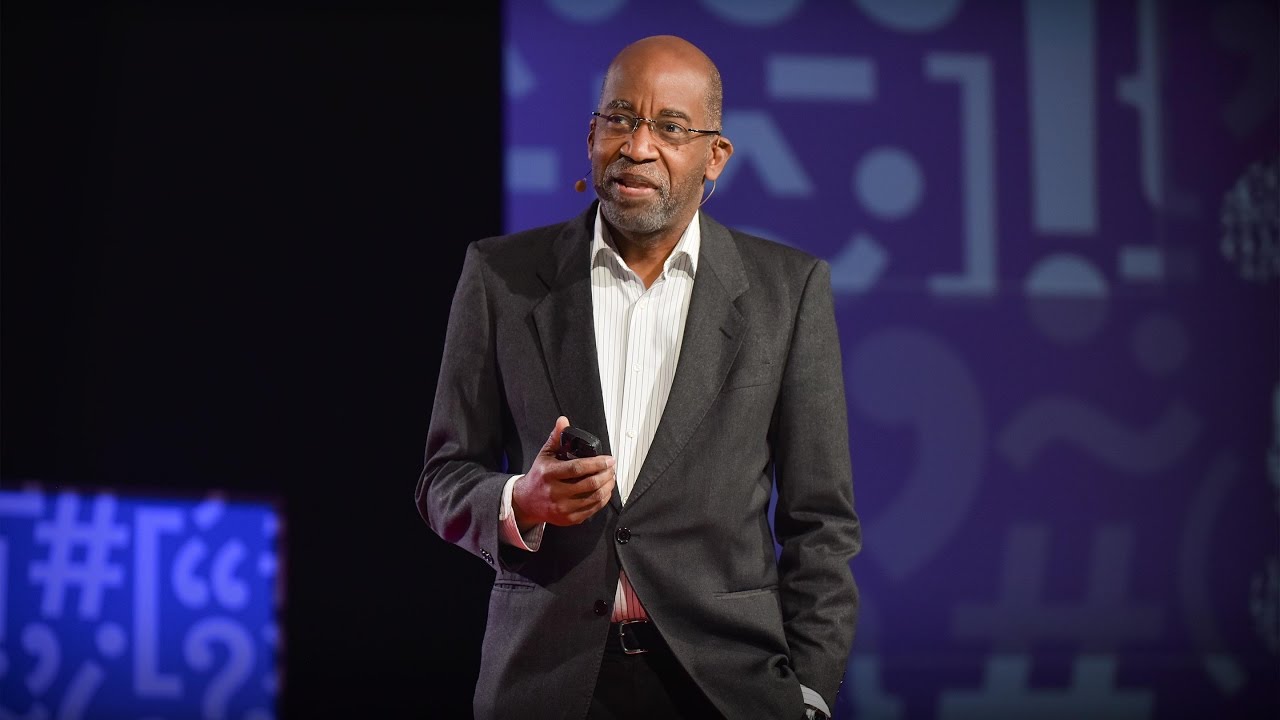

TED要約:コンピューターが私たちよりも賢くなったら何が起こるのか?

オックスフォード大学のスウェーデン人哲学者であるニック・ボストロムが「コンピューターが私たちよりも賢くなったら何が起こるのか?」について語りました。この動画の要点と要約をまとめました

スピーカー

ニック・ボストロム

専門分野:存在リスク、人類の進化倫理、超知能リスク

経歴:オックスフォード大学未来人類学研究所所長。人類の進化における存在リスク、超知能リスクについての研究で知られる。

3つの要点

- 要点1

人類の状況を考慮することが重要だ。 - 要点2

AIはまだ人間レベルの知能には及ばない。 - 要点3

超知能AIの制御と安全対策が重要だ。

要約

人間の条件と異常

私たちは、数学者、哲学者、コンピュータ科学者のチームと一緒に働いており、機械知能の未来について考えています。しかし、私は現在の人類の状況を考慮することが重要だと思っています。地球の歴史を見ると、私たちはまだ新参者です。もし地球が1年前に作られたとしたら、人類はたった10分しか存在していません。私たちの文明の歴史を見ると、現在の状況が通常とはかけ離れていることがわかります。技術の進歩は生産性に大きな影響を与えていますが、それはわずかな変化の結果です。これを理解することが重要です。

人工知能の台頭

人工知能は、コマンドベースのシステムから進化してきました。機械学習のパラダイムシフトを経験し、アルゴリズムが生データから学習するようになりました。これは乳児が学ぶのと同じ方法です。このアプローチにより、AIは言語翻訳やコンピュータゲームなど、さまざまな分野で成果を上げました。しかし、AIはまだ人間レベルの知能には及ばず、特に人間の複雑な思考には劣っています。そのため、AIがどれだけ進化しているのかという問題が生じます。

機械超知能の可能性

主要なAI専門家の調査によると、2040年または2050年までに人間レベルの機械知能を達成する確率は50%です。しかし、真の可能性は機械超知能の開発にあります。これは知能の爆発をもたらす可能性があります。AIの力は人間の能力を超え、さまざまな分野で急速な進歩をもたらすことができます。そのため、超知能AIの制御と影響についての懸念が生じます。AIの開発は私たちの価値観に基づいて行われ、安全対策が重要です。

制御問題と安全性の確保

超知能AIの創造は重要な課題ですが、その安全性の確保も重要です。リスクは、AIの開発の技術的な課題を解決する一方で、制御問題を解決しないまま進めることにあります。このリスクを軽減するためには、制御問題の解決策を事前に見つけることが重要です。いくつかの側面はさらなる開発を必要とするかもしれませんが、事前に解決できることが多ければ、機械知能時代への移行によりよく準備することができます。これは人類の未来にとって非常に重要な課題であり、慎重に追求する価値があります。

▼今回の動画

編集後記

▼ライターの学び

人類の進歩は技術の小さな変化によってもたらされている

機械知能の未来に対する考察は重要であり、進歩を慎重に追求するべきだと思いました!

▼今日からやってみよう

今日から自分の好きなことを1つ見つけて、少しでも時間を作って楽しんでみよう!

日常の忙しさに追われる中で、自分自身を大切にするためにも、自分の好きなことに時間を割くことはとても重要です。少しでも時間を作って、心を豊かにする活動を楽しんでみましょう!